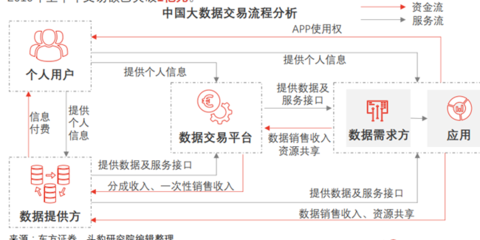

在數字化浪潮席卷全球的今天,數據已成為驅動經濟與社會發展的核心生產要素。數據交易服務作為釋放數據價值的重要途徑,正蓬勃發展。確保數據在跨地域、跨機構的交易流轉中,能夠安全、高效、一致地同步,是多數據中心間復制技術面臨的嚴峻挑戰。本文將探討在數據交易服務這一特定場景下,不同復制技術的“較量”與選擇策略。

一、技術競技場:主流復制模式剖析

數據交易服務對復制技術提出了獨特要求:高實時性以保證交易數據的時效性,強一致性以確保交易結果的準確無誤,高吞吐量以應對高頻交易,以及跨云、跨域的靈活部署能力。圍繞這些需求,幾種主流技術展開了激烈角逐:

- 基于日志的異步復制: 以數據庫事務日志(如MySQL binlog, PostgreSQL WAL)或變更數據捕獲(CDC)技術為基礎。其優勢在于對源端影響小、延遲相對較低,并能實現異構數據源同步,非常適合將交易數據從生產中心準實時地復制到分析或備份中心。但在強一致性要求極高的金融交易場景,異步特性可能帶來短暫的數據不一致風險。

- 同步/半同步復制: 要求數據必須在多個數據中心同時提交成功才算完成,提供了最強的數據一致性保證,是金融級數據交易服務的“安全鎖”。其代價是寫入延遲顯著增加,網絡抖動會直接影響交易性能,且跨長距離部署成本高昂。

- 多活復制技術: 允許數據在多個數據中心同時進行讀寫,通過沖突檢測與解決機制(如最后寫入獲勝、業務規則合并等)來維護最終一致性。這種模式極大提升了數據交易服務的可用性和就近訪問體驗,但實現復雜度最高,對應用改造和全局時鐘依賴性強,適用于對可用性要求高于強一致性的場景。

- 對象存儲與CDN復制: 對于數據交易中涉及的非結構化數據(如影像、文檔),對象存儲的跨區域復制和內容分發網絡(CDN)提供了高效、彈性的解決方案,側重于高吞吐和大容量,但通常不保證事務一致性。

二、權衡之道:數據交易服務的技術選型

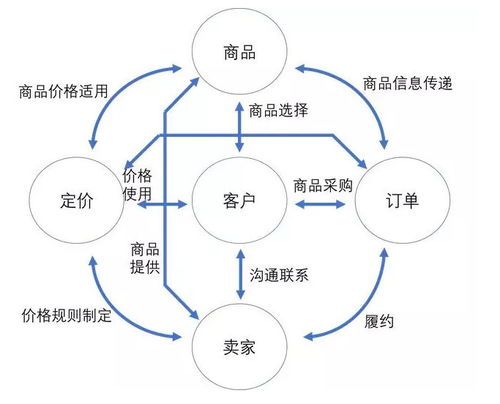

沒有一種技術能“包打天下”。數據交易服務提供商需根據業務特性和數據類別,進行精細化選擇和組合:

- 高頻實時交易數據: 通常采用 “同步/半同步復制為主,異步復制兜底” 的混合架構。核心交易鏈路使用同步復制確保資金安全,而異步復制則用于數據歸檔、審計和下游分析,平衡性能與一致性。

- 數據產品與資產目錄: 這類數據變更相對低頻,但對全局可訪問性要求高。多活復制技術 或 基于CDC的最終一致性異步復制 是理想選擇,能確保買方能即時查詢到最新的數據產品元數據和樣本信息。

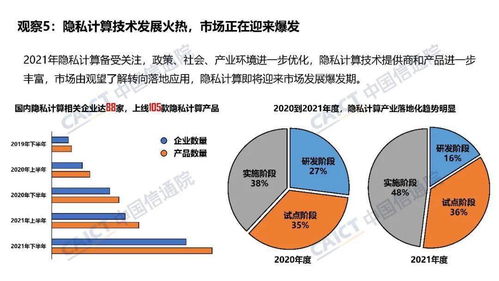

- 隱私計算與聯邦學習場景: 數據“可用不可見”是核心。此時,復制的不再是原始數據,而是加密后的中間結果或模型參數。技術重點轉向 安全通道的建立 和 計算任務的協同調度,傳統的數據復制技術演變為 安全多方計算協議的支撐層。

三、未來挑戰與演進方向

隨著數據交易規模的擴大和監管的深化,復制技術還需應對以下挑戰:

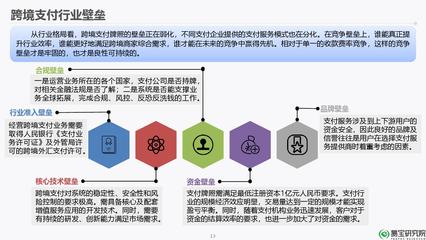

- 合規性復制: 滿足數據主權、數據跨境流動(如GDPR)的法規要求,需要復制技術能夠與數據分類分級、脫敏、審計追蹤等功能深度集成,實現“合規感知”的智能路由。

- 成本與效率的再平衡: 跨數據中心帶寬成本高昂。未來的技術將更注重 智能壓縮、增量同步、帶寬預測調度 等優化手段,并探索在邊緣節點進行數據預處理和過濾,只將必要數據同步到中心。

- 統一數據編排: 在混合云和多云環境下,數據復制將與數據目錄、數據血緣、數據質量管理等能力結合,形成統一的 數據流動性編排平臺,為數據交易提供端到端的可信保障。

結論

多數據中心間的數據復制技術,是數據交易服務這座價值金礦的“輸送管道”和“安全護欄”。這場技術較量并非要決出單一勝者,而是推動形成一套層次化、場景化的綜合解決方案。成功的服務商必然是那些能夠深刻理解業務,并靈活運用和集成多種復制技術,在數據的“一致性、可用性、性能與成本”之間找到最佳動態平衡點的實踐者。隨著技術的持續演進,更智能、更安全、更高效的數據流動能力,必將成為數據交易服務商的核心競爭力。